近期,OpenAI最新的多模态基础模型GPT-4V遭遇了多次挑战,其表现令人“大跌眼镜”。在与视觉和语言理解能力相关的基准测试中,GPT-4V出现了一些错误,引起了科研社区的广泛关注。

首次明确提出GPT-4V视觉性能问题的研究来自上海交通大学和上海人工智能实验室。他们通过178页的论文,全面测评了GPT-4V在医疗领域的视觉性能,并通过128个案例分析评估了其在多模态医疗诊断领域的性能。虽然GPT-4V在识别医学图像模态、定位解剖结构、发现和定位异常等方面表现优秀,但在疾病诊断和生成综合报告方面仍面临挑战。

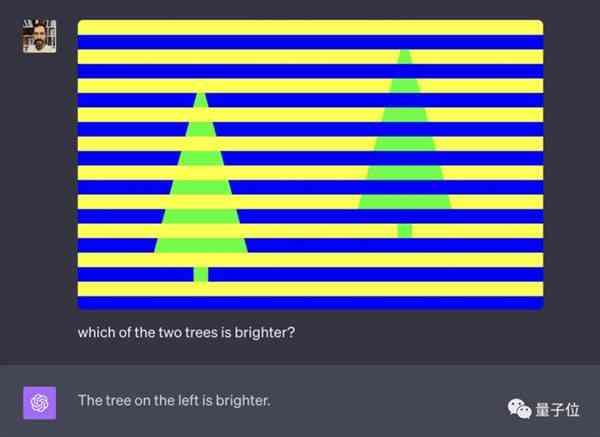

紧随其后,马里兰大学发布了首个专为GPT-4V视觉模型设计的基准测试HallusionBench,结果显示其错误率高达90%。这些问题包括对基本数学原理如勾股定理的误用和无法识别红绿灯等。进一步的研究发现,GPT-4V在处理一些视觉问题和语言问题时存在错误。错误主要分为语言幻觉和视觉错觉两大类。语言幻觉是指模型在处理问题时受到其参数化知识库的影响,导致对问题的具体环境作出不恰当的假设。视觉错觉则是指模型在处理视觉内容时容易出现错误。

这些发现表明,尽管大型多模态模型在计算机视觉和自然语言处理方面取得重大进展,但仍需进一步发展以支持实际医疗应用和临床决策,同时也需要对其视觉理解能力进行更深入的研究和改进。